El auge de plataformas como Databricks ha transformado profundamente la forma en que las organizaciones trabajan con datos. Lo que antes era un flujo relativamente controlado, hoy es un ecosistema distribuido donde la información se mueve entre equipos de analítica, ciencia de datos, ingeniería y machine learning.

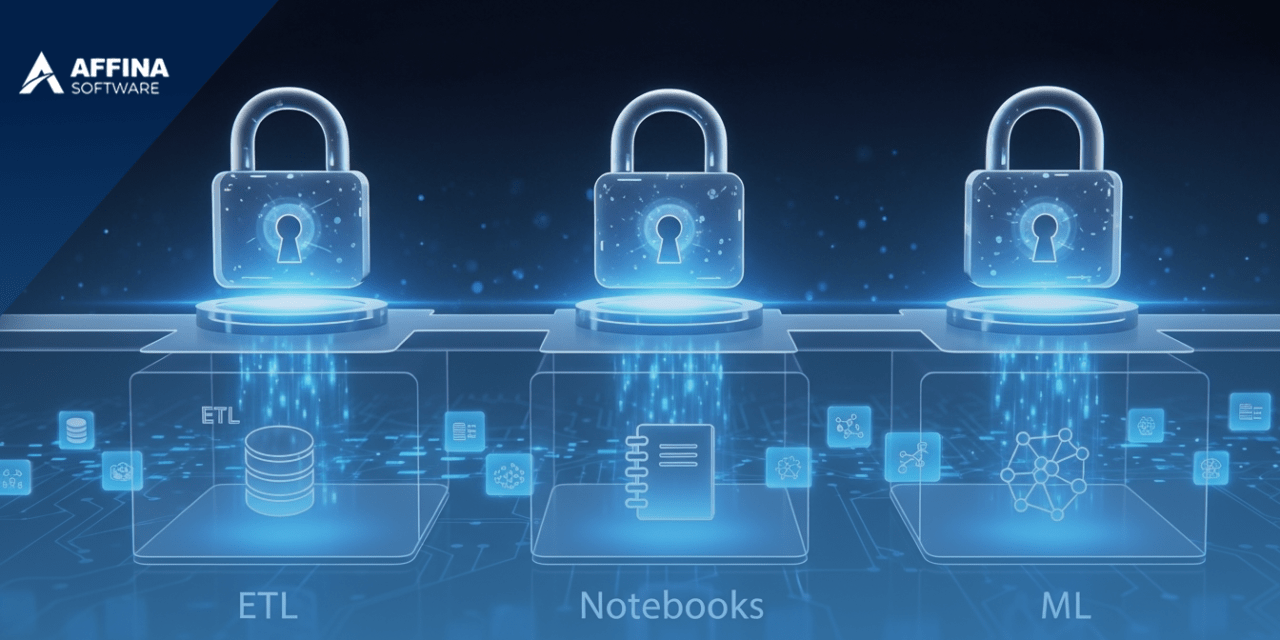

Este cambio no solo ha traído velocidad e innovación. También ha ampliado la superficie de exposición de los datos sensibles. Información que antes vivía en sistemas cerrados ahora no solo circula, sino que se replica, se transforma y se redistribuye constantemente a través de pipelines, notebooks, entornos colaborativos y modelos de inteligencia artificial.

En este contexto, el data masking deja de ser una práctica opcional o de cumplimiento básico. Se convierte en un mecanismo esencial para equilibrar dos fuerzas que constantemente chocan: la necesidad de acceso a datos reales y la obligación de proteger información sensible a lo largo de todo su ciclo de vida.

El verdadero reto no es ocultar datos.

Es hacerlo sin destruir su valor analítico… ni frenar el flujo en el que viven.

¿Cómo funciona el data masking en Databricks?

Databricks incorpora capacidades nativas que permiten aplicar protección sobre los datos sin necesidad de modificar su versión original. Este enfoque resulta clave en entornos donde múltiples usuarios necesitan acceder a la misma fuente de información, pero bajo distintos niveles de privilegio.

El concepto central es el dynamic data masking, una técnica que permite transformar los datos en tiempo real según el perfil del usuario que realiza la consulta. Esto significa que un mismo dataset puede presentar diferentes versiones dependiendo de quién lo esté consumiendo, sin duplicar la información ni generar múltiples copias.

Aquí hay un punto importante: este tipo de enmascaramiento ocurre principalmente en la capa de consumo del dato, es decir, cuando el pipeline ya entregó la información para ser utilizada. Esto permite controlar el acceso, pero implica que el dato sensible sigue existiendo en etapas previas del flujo.

Column masking

El column masking actúa directamente sobre campos específicos que contienen información sensible, como nombres, correos electrónicos, números de identificación o datos financieros.

En lugar de eliminar estos valores, se sustituyen por versiones enmascaradas que mantienen cierta estructura, pero eliminan su valor real. Esto permite que los datos sigan siendo útiles para pruebas, análisis o desarrollo, sin exponer información crítica.

Por ejemplo, un número de tarjeta puede conservar su formato, pero solo mostrar los últimos cuatro dígitos. De esta forma, el dato sigue siendo funcional dentro de un proceso, pero pierde su capacidad de ser explotado.

Dentro del flujo de datos, este enfoque suele aplicarse cuando la información ya está disponible para consumo, lo que refuerza la seguridad en el acceso, pero no necesariamente en el tránsito previo.

Dynamic views

Las dynamic views añaden una capa adicional de control. En lugar de aplicar reglas directamente sobre columnas, se construyen vistas lógicas que transforman los datos en función de condiciones más complejas.

Estas condiciones pueden incluir roles, atributos del usuario o incluso reglas de negocio. El resultado es una experiencia de acceso completamente contextualizada, donde cada usuario interactúa con una versión del dato alineada a sus permisos.

Este enfoque permite adaptar el acceso sin alterar el pipeline subyacente, lo que resulta útil en entornos donde múltiples equipos consumen los mismos datos con necesidades distintas.

Otros enfoques complementarios

Además del masking dinámico, existen otras técnicas que suelen integrarse dentro del ecosistema de Databricks para reforzar la protección de datos en distintas etapas del flujo.

El shuffling, por ejemplo, permite desordenar valores dentro de una columna, preservando la distribución estadística pero rompiendo la relación directa con los datos originales. Esto es útil cuando los datos ya están en etapas analíticas, pero se requiere evitar asociaciones directas.

La encriptación, tanto en tránsito como en reposo, protege los datos mientras se mueven a través del pipeline o se almacenan en diferentes capas de la arquitectura. Sin embargo, no resuelve el problema del acceso interno, donde el masking sigue siendo necesario.

Por último, el nulling elimina completamente ciertos valores, bloqueando su acceso incluso en contextos controlados. Es una técnica más agresiva, pero útil cuando ciertos datos simplemente no deben circular dentro del flujo.

El verdadero problema: los entornos no productivos

Uno de los errores más comunes en la gestión de datos es asumir que el riesgo se concentra en producción. Sin embargo, en la práctica, muchos incidentes ocurren en entornos no productivos.

Estos entornos, que incluyen desarrollo, pruebas y analítica, suelen operar con menores controles de seguridad. Aun así, frecuentemente utilizan copias de datos reales para garantizar la calidad de los procesos.

Aquí es donde el problema se vuelve más crítico: los datos no solo se almacenan, sino que viajan a través de distintos pipelines internos, replicándose entre entornos sin siempre mantener las mismas políticas de protección.

Databricks, al ser una plataforma fuertemente orientada a analítica e innovación, suele estar en el centro de estos flujos. Esto convierte a los entornos no productivos en un punto crítico donde el data masking deja de ser una opción y se vuelve una necesidad operativa.

Retos del data masking en Databricks

Aunque las capacidades nativas de Databricks ofrecen un punto de partida sólido, su implementación en entornos reales presenta varios desafíos que no siempre son evidentes al inicio.

Inconsistencias en pipelines

Uno de los problemas más frecuentes es la falta de consistencia en la aplicación del masking a lo largo de diferentes sistemas y pipelines.

Cuando cada etapa del flujo aplica reglas distintas, los datos dejan de ser coherentes entre entornos. Esto impacta directamente en la calidad del análisis, la integración de sistemas y el entrenamiento de modelos de inteligencia artificial.

Un modelo entrenado con datos enmascarados de una forma puede comportarse de manera inesperada si se alimenta con datos transformados de otra manera.

Escalabilidad en entornos distribuidos

Databricks opera sobre arquitecturas distribuidas, lo que implica que las operaciones no ocurren en un solo punto, sino a través de múltiples nodos y procesos paralelos.

Aplicar masking en este contexto implica evaluar permisos, transformar datos y ejecutar consultas de forma distribuida. Esto introduce una capa adicional de complejidad que puede impactar el rendimiento si no se gestiona correctamente.

A medida que el volumen de datos, usuarios y flujos crece, este reto se vuelve más evidente.

Complejidad del masking dinámico

El dynamic masking aporta flexibilidad, pero también introduce retos importantes en términos de consistencia y trazabilidad.

Dado que los datos se transforman en tiempo de consulta, diferentes usuarios pueden trabajar con versiones distintas del mismo dataset. Esto puede generar confusión, especialmente en procesos colaborativos o en auditorías.

Además, dificulta la reproducibilidad, un factor clave en analítica avanzada y machine learning, donde entender exactamente qué datos se utilizaron es fundamental.

Limitaciones operativas

A medida que las organizaciones escalan, las soluciones nativas pueden volverse difíciles de gestionar.

Modificar reglas, mantener políticas consistentes y adaptarse a nuevos requerimientos puede implicar un esfuerzo significativo, especialmente en entornos donde los pipelines cambian constantemente y requieren ajustes continuos.

¿Por qué el data masking es crítico en entornos de inteligencia artificial?

La inteligencia artificial depende de datos de alta calidad para generar resultados precisos. Sin embargo, esos datos suelen contener información sensible.

Esto genera un dilema: cuanto más realista es el dato, mayor es el riesgo de exposición.

En entornos de IA, este riesgo se amplifica debido a factores como la reidentificación de datos, la persistencia de información en modelos entrenados y la dificultad para rastrear el origen exacto de los datos utilizados dentro del pipeline.

Por ello, el data masking se convierte en una herramienta clave para permitir el uso de datos en estos contextos sin comprometer la privacidad ni el cumplimiento normativo.

¿Qué enfoque elegir para data masking en Databricks?

No existe una solución única. La elección depende del nivel de madurez, complejidad y necesidades de cada organización.

Capacidades nativas

Ofrecen integración directa y control en tiempo real, especialmente en la capa de consumo. Sin embargo, pueden presentar limitaciones en términos de escalabilidad y protección en etapas previas del pipeline.

Scripts personalizados

Permiten adaptarse a necesidades específicas dentro de distintos puntos del flujo de datos, pero requieren mantenimiento constante y pueden generar deuda técnica con el tiempo.

Soluciones especializadas

Las herramientas de terceros permiten centralizar el control, automatizar procesos y garantizar consistencia a lo largo de todo el pipeline.

En escenarios complejos, este enfoque suele ofrecer una ventaja clara al reducir la carga operativa y mejorar la gobernanza de datos de extremo a extremo.

Automatizando el data masking en Databricks

La automatización cambia el paradigma del data masking.

En lugar de aplicar transformaciones en cada consulta, se construyen flujos donde los datos se identifican, clasifican y enmascaran desde etapas tempranas del pipeline, antes de ser consumidos.

Esto permite trabajar con datasets listos para analítica, manteniendo consistencia y reduciendo el riesgo de exposición a lo largo de todo el ciclo de vida del dato.

Además, integrar procesos de discovery, masking y entrega dentro de un mismo flujo mejora significativamente la eficiencia operativa y la calidad de los datos.

Conclusión

El data masking en Databricks no es simplemente una funcionalidad más dentro del stack de datos. Es un componente clave en la estrategia de protección y uso responsable de la información.

Pero su verdadero valor aparece cuando se entiende como parte del flujo completo de datos, no solo como una capa de control en el acceso.

Las organizaciones que logran integrar el masking de forma consistente a lo largo de sus pipelines no solo reducen riesgos, sino que también aceleran su capacidad de innovar sin fricción.

Porque al final, los datos no se quedan quietos.

Se mueven, se transforman y se reutilizan constantemente.

Y si la protección no se mueve con ellos…

eventualmente deja de proteger.