DataOps se menciona mucho, pero se explica poco. Y cuando se explica, casi siempre se hace desde la herramienta o desde el buzzword, no desde el problema real.

En esencia, DataOps es una disciplina operativa, no una tecnología. Nace para resolver algo muy concreto: los datos dejaron de ser estáticos, pero los procesos para operarlos siguen siendo manuales, frágiles y lentos.

Por eso tanta confusión. No es solo automatización. No es solo pipelines. No es solo gobierno de datos. Es la orquestación consciente de todo lo que ocurre entre que un dato nace y alguien toma una decisión con él

DataOps no es una herramienta, es una forma de operar datos.

Uno de los errores más comunes es pensar que DataOps se “instala”. En realidad, DataOps se construye. Es una disciplina que busca que los datos fluyan desde su origen hasta su consumo sin fricción, sin sorpresas y sin depender de héroes operativos.

En entornos reales, los datos no son estáticos. Cambian los esquemas, cambian las fuentes, cambian los volúmenes y cambian los objetivos del negocio. DataOps existe para que esos cambios no rompan procesos ni generen desconfianza en los resultados.

El flujo continuo de datos como punto de partida

DataOps parte de una idea sencilla pero exigente: los datos siempre están en movimiento. Ingestas que llegan a distintas horas, transformaciones que dependen de múltiples fuentes y consumidores que esperan información consistente.

Aquí el reto no es solo que el pipeline funcione una vez. El reto es que funcione todos los días, bajo presión, con picos de carga y con cambios inevitables. DataOps pone el foco en la continuidad operativa del flujo, no en ejecuciones aisladas que solo funcionan en condiciones ideales.

Automatización que reduce riesgo, no solo trabajo manual

En muchos equipos, la automatización se introduce para ahorrar tiempo. En DataOps, la automatización existe para reducir riesgo. Cada paso manual es una oportunidad de error, retraso o inconsistencia.

DataOps promueve automatizar procesos repetitivos, validaciones y ejecuciones críticas, pero siempre con reglas claras y visibilidad. No se trata de automatizar a ciegas, sino de construir procesos que se ejecuten de forma predecible, incluso cuando nadie está mirando.

Control de cambios: el punto que casi nadie menciona.

Uno de los mayores dolores en entornos de datos aparece cuando algo deja de cuadrar y nadie sabe qué cambió. DataOps introduce prácticas de control y trazabilidad para esquemas, reglas y procesos de transformación.

Esto no busca frenar la evolución del modelo de datos. Al contrario. Busca permitir el cambio sin perder control. Saber qué se modificó, cuándo ocurrió y qué impacto tuvo se vuelve fundamental cuando los datos alimentan decisiones de negocio.

Observabilidad: ver los datos como un sistema vivo.

Sin visibilidad, no hay operación. DataOps entiende los datos como un sistema vivo que debe ser observado constantemente. No solo para detectar fallos, sino para identificar degradaciones progresivas que, con el tiempo, terminan afectando al negocio.

La observabilidad en DataOps permite entender dónde se rompe el flujo, qué procesos se vuelven más lentos y qué datos empiezan a perder confiabilidad antes de que alguien levante la mano.

Calidad integrada al proceso, no al final.

Tradicionalmente, la calidad de datos se revisa cuando el problema ya llegó al usuario. DataOps cambia ese enfoque. La calidad se valida durante el flujo, no después.

Reglas, controles y verificaciones se ejecutan como parte del proceso operativo. Así, los datos incorrectos no avanzan silenciosamente. Se detectan temprano, cuando todavía es posible corregir sin impactos mayores.

Colaboración como requisito operativo.

DataOps también rompe con los silos clásicos. Desarrollo, operación y análisis dejan de trabajar de forma aislada. Todos participan del mismo flujo y comparten responsabilidad sobre el resultado final.

Esto no es una cuestión cultural abstracta. Es una necesidad práctica cuando múltiples equipos tocan los mismos datos y cualquier cambio puede tener efectos en cadena.

Cómo ERStudio se integra en una estrategia real de DataOps

Uno de los puntos más débiles en muchas iniciativas de DataOps no es la tecnología, sino la falta de claridad sobre qué se hizo, por qué se hizo y cómo se conecta con el resto del flujo de datos.

ERStudio permite que el análisis, el código y la documentación convivan en un mismo espacio. Los supuestos, transformaciones y decisiones quedan registrados junto al modelo, lo que facilita que otros miembros del equipo comprendan el proceso completo, no solo el resultado final. Esta documentación viva reduce retrabajo y evita que el conocimiento se pierda con el tiempo o los cambios de equipo.

Además, ERStudio habilita colaboración y sincronización de modelos dentro de un entorno compartido. Los equipos pueden versionar, revisar y evolucionar análisis de forma controlada, manteniendo coherencia entre personas y proyectos. Esto refuerza el linaje de datos y modelos, haciendo visible cómo se generan los resultados y qué fuentes los alimentan.

Así, ERStudio deja de ser solo una herramienta de análisis y se convierte en un habilitador práctico de DataOps: más claridad, mejor colaboración y mayor confianza en los datos.

Delphix como habilitador de velocidad y estabilidad en DataOps

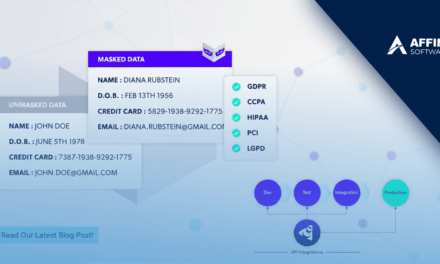

Una estrategia DataOps sólida no puede depender de bases de datos lentas, rígidas o difíciles de replicar. Cuando el acceso a datos confiables tarda días o semanas, todo el flujo se frena. Delphix ataca directamente este problema al transformar la forma en que los datos se aprovisionan, sincronizan y gestionan.

Delphix permite crear copias virtuales de bases de datos que conservan consistencia y realismo, pero sin el costo ni el impacto operativo de duplicar información completa. Esto habilita a equipos de desarrollo, pruebas y analítica a trabajar en paralelo, sin bloquear producción ni depender de procesos manuales. En términos de DataOps, esto significa menos fricción entre equipos y ciclos mucho más cortos para experimentar, validar y entregar cambios.

Además, Delphix facilita la sincronización de datos entre entornos y plataformas, lo que resulta especialmente valioso en escenarios de migración o adopción de nube. Los datos pueden moverse y actualizarse entre infraestructuras on-premise y cloud de forma controlada, reduciendo riesgos y tiempos muertos. Dentro de DataOps, Delphix convierte a la base de datos en un activo dinámico, disponible cuando se necesita y alineado con la velocidad que exige el negocio.

Entonces, ¿por qué DataOps sigue siendo confuso?

Porque DataOps no cabe en una definición corta. No es una herramienta, no es un rol único y no es una moda pasajera. Es una disciplina que exige orden, visibilidad y responsabilidad compartida.

Explicarlo bien implica hablar de problemas reales, no solo de conceptos bonitos. Y eso es justo lo que muchas veces se evita.

Conclusión

DataOps no aparece para complicar la gestión de datos. Aparece porque los datos se volvieron críticos y los procesos tradicionales ya no alcanzan.

Cuando se implementa correctamente, los errores no desaparecen por arte de magia. Aparecen antes, se entienden mejor y se corrigen con menos impacto. Ahí es donde DataOps deja de ser un término confuso y se convierte en una ventaja operativa real