La adopción de inteligencia artificial dentro de las organizaciones ha dejado de ser una iniciativa experimental para convertirse en un componente central de la operación. Modelos predictivos, automatización y analítica avanzada dependen cada vez más de datos disponibles, consistentes y accesibles en tiempo real.

Sin embargo, este crecimiento ha expuesto una realidad que muchas organizaciones ya enfrentaban, pero que ahora se vuelve crítica: la gestión de datos no está diseñada para la velocidad ni la complejidad que exige la inteligencia artificial.

En este contexto, no basta con almacenar grandes volúmenes de información. Es necesario habilitar un acceso eficiente, gobernado y flexible. Y es aquí donde la virtualización de datos comienza a tomar un papel relevante dentro de la arquitectura moderna.

El reto de gestionar datos para inteligencia artificial

La inteligencia artificial depende directamente de la calidad, disponibilidad y consistencia de los datos. Sin embargo, en la mayoría de las organizaciones, la información se encuentra distribuida en múltiples sistemas, plataformas y formatos.

Bases de datos relacionales, data lakes, aplicaciones SaaS y entornos híbridos conviven dentro del mismo ecosistema, generando fragmentación y duplicidad.

Este escenario introduce fricciones importantes. Los equipos deben invertir tiempo en localizar datos, integrarlos, transformarlos y validar su calidad antes de poder utilizarlos. En muchos casos, este proceso consume más recursos que el propio desarrollo de modelos de inteligencia artificial.

El problema no es la falta de datos.

Es la dificultad para gestionarlos de forma eficiente.

La necesidad de un enfoque unificado

Frente a este nivel de complejidad, las organizaciones requieren un enfoque que permita acceder a los datos sin depender de procesos pesados de integración o replicación constante.

Tradicionalmente, la respuesta a este problema ha sido mover los datos hacia un repositorio central. Sin embargo, este enfoque no escala en entornos donde la información crece de forma exponencial y se actualiza continuamente.

Además, la duplicación de datos introduce riesgos adicionales en términos de gobernanza, seguridad y consistencia.

La necesidad ya no es centralizar todo…

sino conectar todo de forma inteligente.

Virtualización de datos como habilitador estratégico

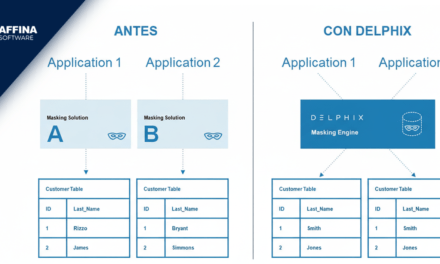

La virtualización de datos propone un cambio en la forma de abordar este problema.

En lugar de mover los datos, permite acceder a ellos desde su origen, creando una capa lógica que unifica la información sin necesidad de replicarla físicamente.

Esto significa que los usuarios y las aplicaciones pueden consultar datos distribuidos como si estuvieran en un solo lugar, manteniendo al mismo tiempo su ubicación original.

Este enfoque resulta especialmente relevante en entornos de inteligencia artificial, donde la velocidad de acceso y la frescura del dato son factores críticos.

Al eliminar la necesidad de mover y transformar datos constantemente, la virtualización reduce tiempos de preparación y permite trabajar con información más actualizada.

Gobernanza y control en entornos distribuidos

Uno de los principales desafíos en la gestión de datos para inteligencia artificial es mantener control sobre la información.

A medida que los datos se distribuyen entre distintos sistemas, garantizar su calidad, seguridad y cumplimiento se vuelve más complejo.

La virtualización de datos no elimina este reto, pero sí ofrece una forma más estructurada de abordarlo.

Al centralizar el acceso a través de una capa lógica, es posible definir políticas de gobernanza, control de acceso y seguridad de manera consistente, independientemente de dónde residan los datos.

Esto permite mantener visibilidad y control sin sacrificar flexibilidad, algo fundamental en entornos donde los datos son utilizados por múltiples equipos y aplicaciones.

Impacto en la eficiencia operativa

La adopción de virtualización de datos tiene un impacto directo en la eficiencia de los equipos que trabajan con inteligencia artificial.

Al reducir el tiempo necesario para preparar y acceder a los datos, los equipos pueden enfocarse en actividades de mayor valor, como el desarrollo de modelos, la experimentación y la generación de insights.

También se reduce la dependencia de procesos manuales y pipelines complejos, lo que disminuye errores y mejora la consistencia de los resultados.

En entornos donde la velocidad de ejecución es clave, esta capacidad puede marcar una diferencia significativa en la competitividad de la organización.

Evolución de la gestión de datos

La incorporación de inteligencia artificial está forzando una evolución en la forma en que las organizaciones gestionan sus datos.

Los modelos tradicionales, basados en centralización y procesos rígidos, comienzan a ser reemplazados por enfoques más flexibles, donde el acceso y la integración se adaptan a las necesidades del negocio.

La virtualización de datos se posiciona como una pieza clave dentro de esta evolución, al permitir una gestión más ágil, escalable y alineada con los requerimientos actuales.

No se trata de reemplazar completamente las arquitecturas existentes, sino de complementarlas con una capa que facilite el acceso y mejore la eficiencia.

Conclusión

La gestión de datos en entornos impulsados por inteligencia artificial ya no puede depender únicamente de modelos tradicionales.

La necesidad de acceder a información distribuida, mantener su calidad y garantizar su seguridad exige un enfoque más flexible y eficiente.

La virtualización de datos responde a este reto al permitir un acceso unificado sin necesidad de replicación constante, reduciendo fricciones operativas y mejorando la velocidad de análisis.

En un contexto donde la inteligencia artificial depende directamente de la disponibilidad del dato, esta capacidad se convierte en un habilitador estratégico.