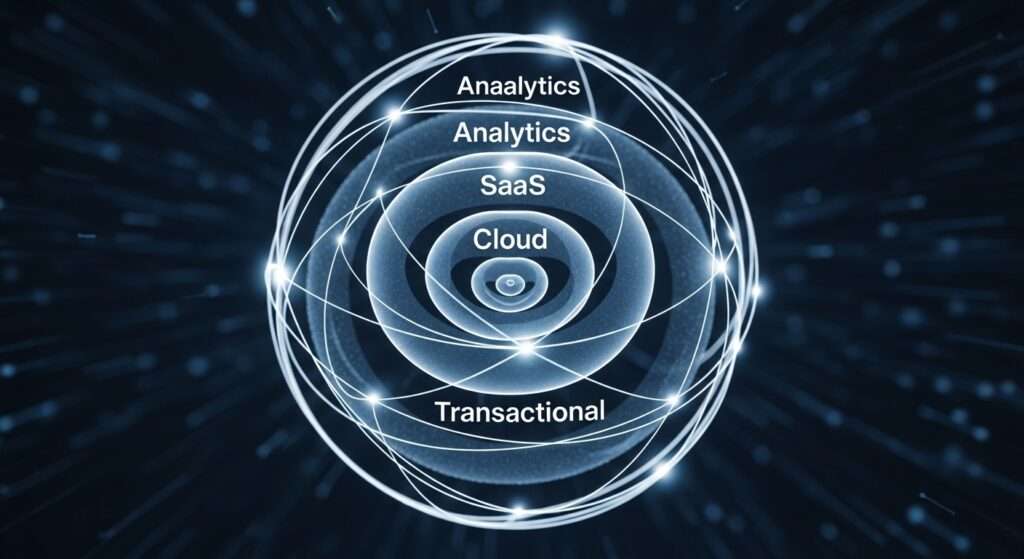

A medida que las organizaciones adoptan modelos basados en datos, uno de los principales desafíos deja de ser la generación de información y pasa a ser su acceso. Los datos ya no viven en un solo lugar. Se distribuyen entre bases de datos transaccionales, data lakes, aplicaciones SaaS y plataformas cloud, lo que introduce complejidad operativa y retrasa su uso efectivo.

En este contexto, la virtualización de datos surge como una respuesta a este problema estructural. En lugar de mover o replicar información, permite acceder a ella desde múltiples fuentes a través de una capa unificada.

Este enfoque no solo simplifica el acceso, sino que también se alinea directamente con los principios de DataOps, donde la velocidad, la automatización y la disponibilidad de datos son elementos clave para la operación.

Qué es data virtualization y por qué importa en DataOps

La virtualización de datos es una tecnología que permite acceder y manipular información desde distintas fuentes sin necesidad de moverla físicamente. En lugar de replicar datos en nuevos sistemas, crea una capa lógica que abstrae su ubicación y formato.

Esto tiene implicaciones directas en DataOps.

En un entorno tradicional, los equipos dependen de procesos ETL, copias de datos y pipelines complejos para poder trabajar. Cada nuevo requerimiento implica tiempo, validación y coordinación entre equipos. La virtualización elimina gran parte de esta fricción al permitir acceso inmediato a los datos, manteniéndolos en su origen.

El resultado es un flujo de trabajo más ágil, donde los datos están disponibles cuando se necesitan, sin procesos intermedios que ralenticen la operación.

Cómo funciona: una capa lógica sobre múltiples fuentes

El funcionamiento de la virtualización de datos se basa en una capa intermedia que actúa como puente entre los sistemas de origen y los consumidores de datos.

Cuando un usuario realiza una consulta, esta capa traduce la solicitud, la distribuye entre las distintas fuentes y consolida los resultados en una única respuesta. Todo esto ocurre sin necesidad de mover o duplicar la información.

Desde la perspectiva de DataOps, este modelo permite desacoplar el acceso a datos de su almacenamiento. Los equipos pueden consumir información sin preocuparse por su ubicación, lo que facilita la integración entre sistemas y reduce la complejidad técnica.

Además, al trabajar sobre metadata y no sobre copias físicas, se mantiene una mayor consistencia y se evitan problemas derivados de datos desactualizados.

Dos enfoques de virtualización y su impacto en DataOps

El enfoque de virtualización de datos no es único. Existen distintas formas de aplicarlo dependiendo del objetivo dentro de la organización.

Por un lado, la virtualización orientada a analítica permite integrar múltiples fuentes para generar vistas unificadas que facilitan la toma de decisiones. Este enfoque es clave en entornos donde se requiere acceso en tiempo real a información distribuida.

Por otro lado, la virtualización orientada a desarrollo y pruebas permite crear copias virtuales de datos que pueden provisionarse rápidamente para equipos técnicos. Estas copias son funcionales, pero no implican duplicación física, lo que reduce tiempos y costos operativos.

Dentro de DataOps, ambos enfoques son complementarios. Mientras uno acelera el análisis, el otro optimiza los ciclos de desarrollo, permitiendo que los datos estén disponibles en cada etapa del pipeline.

Eliminación de cuellos de botella en pipelines de datos

Uno de los mayores problemas en DataOps es la dependencia de procesos centralizados para acceder a datos.

Solicitudes a equipos de infraestructura, tiempos de espera para provisionar entornos y retrasos en la actualización de datasets generan cuellos de botella que afectan directamente la velocidad de entrega.

La virtualización de datos cambia esta dinámica al permitir acceso bajo demanda. Los equipos pueden trabajar con datasets actualizados sin depender de procesos manuales ni ciclos largos de integración.

Esto se traduce en:

Menor tiempo de preparación de datos

Mayor autonomía para los equipos

Reducción de dependencias operativas

Aceleración en ciclos de desarrollo y análisis

En términos prácticos, permite que DataOps funcione como un sistema continuo y no como una serie de procesos aislados.

Consistencia y gobernanza en un entorno distribuido

Uno de los retos de trabajar con datos distribuidos es mantener consistencia y control.

La virtualización aporta una ventaja importante en este aspecto al centralizar la lógica de acceso en una sola capa. Esto permite aplicar políticas de seguridad, control de acceso y gobernanza sin depender de configuraciones individuales en cada sistema.

Además, facilita la creación de una “fuente única de verdad”, donde los usuarios acceden a datos actualizados directamente desde su origen, evitando inconsistencias generadas por copias desincronizadas.

Para DataOps, esto es clave, ya que permite escalar el acceso a datos sin perder control ni calidad.

Impacto en velocidad y eficiencia operativa

Uno de los beneficios más evidentes de la virtualización de datos es la mejora en la velocidad operativa.

Procesos que antes requerían días o semanas, como la preparación de entornos o la integración de nuevas fuentes, pueden reducirse significativamente al eliminar la necesidad de mover datos.

Esto no solo impacta en tiempos.

También reduce costos de almacenamiento, simplifica la arquitectura y mejora la capacidad de respuesta ante cambios en el negocio.

En un entorno DataOps, donde la eficiencia es crítica, estos beneficios permiten mantener un flujo constante de entrega de valor basado en datos.

Casos de uso dentro de DataOps

La virtualización de datos se integra de forma natural en múltiples escenarios dentro de DataOps.

En pipelines de CI/CD, permite provisionar datos de prueba de forma rápida y consistente.

En analítica, facilita el acceso a información distribuida sin necesidad de consolidación previa.

En gobernanza, centraliza el control sobre el acceso y uso de datos.

En integración, reduce la complejidad de conectar sistemas heterogéneos.

Estos casos de uso reflejan cómo la virtualización no es una herramienta aislada, sino una capa transversal que impacta todo el ciclo de vida de los datos.

Conclusión

La virtualización de datos responde a uno de los principales retos de las arquitecturas modernas: cómo acceder a información distribuida sin incrementar la complejidad operativa.

Al eliminar la necesidad de mover datos y permitir acceso en tiempo real desde múltiples fuentes, esta tecnología se convierte en un habilitador clave para DataOps. Su capacidad para reducir fricción, acelerar procesos y mantener consistencia permite a las organizaciones trabajar con datos de forma más eficiente y alineada con las demandas actuales.

En este contexto, DataOps deja de depender de pipelines rígidos y comienza a operar sobre una base más flexible, donde el acceso a los datos es inmediato y la capacidad de respuesta se convierte en una ventaja competitiva real.