Disponible en audio libro

En el desarrollo moderno de aplicaciones, el código ya no es el problema. Los equipos automatizaron builds, pruebas y despliegues. La infraestructura se define como código y se levanta en minutos. Sin embargo, hay un eslabón que sigue avanzando a paso lento: los datos.

En muchos pipelines de CI/CD, obtener datos actualizados, completos y seguros para desarrollo y pruebas puede tomar días o semanas. Copias manuales, procesos de backup y restore, validaciones posteriores y riesgos de seguridad convierten a los datos en el principal cuello de botella del time to market.

Qué pasa cuando no tienes datos frescos en desarrollo

Trabajar con datos desactualizados o incompletos impacta directamente en la calidad y velocidad de las aplicaciones. Los errores aparecen tarde, las pruebas no reflejan escenarios reales y los equipos repiten ciclos de corrección que consumen tiempo y presupuesto.

El problema se agrava en metodologías CI/CD, donde la entrega continua depende de flujos automatizados y repetibles. Si los datos no pueden integrarse con la misma agilidad que el código, el pipeline se rompe. Releases atrasados, cronogramas incumplidos y ambientes inconsistentes se vuelven parte del día a día.

Además, la mayoría de los datos utilizados en desarrollo y testing provienen de producción. Esto introduce riesgos de cumplimiento y privacidad, ya que los entornos no productivos concentran la mayor cantidad de copias y, paradójicamente, suelen ser los menos protegidos.

CI/CD y pipelines: cuando la automatización se queda a medias

Un pipeline de CI/CD busca que cada cambio de código avance automáticamente por etapas de integración, pruebas, aceptación y despliegue. Pero en la práctica, los datos suelen manejarse fuera de este flujo.

Mientras el código viaja por herramientas como GitHub, Jenkins o GitLab, los datos siguen procesos manuales: solicitudes a DBAs, copias completas de bases, esperas prolongadas y tareas adicionales antes y después de cada refresh. El resultado es claro: los datos no escalan al ritmo del desarrollo.

Sin automatización de datos, los equipos no pueden probar con información realista ni paralelizar trabajos. Esto limita la detección temprana de errores y reduce el valor de las prácticas DevOps.

La problemática central: datos lentos frenan aplicaciones rápidas

En la cadena de desarrollo de una aplicación, la velocidad final depende de tres factores: infraestructura, código y datos. Aunque los dos primeros ya se mueven rápido, los datos siguen siendo el factor más lento.

Este desfase genera impactos concretos:

- Retrasos en releases por falta de ambientes listos.

- Uso excesivo de almacenamiento por copias redundantes.

- Mayor carga operativa para equipos de TI.

- Riesgos de seguridad y cumplimiento en entornos no productivos.

Resolver este punto no es solo una mejora técnica. Es una condición necesaria para que CI/CD funcione de forma completa.

Cómo Delphix entra en acción en los flujos CI/CD

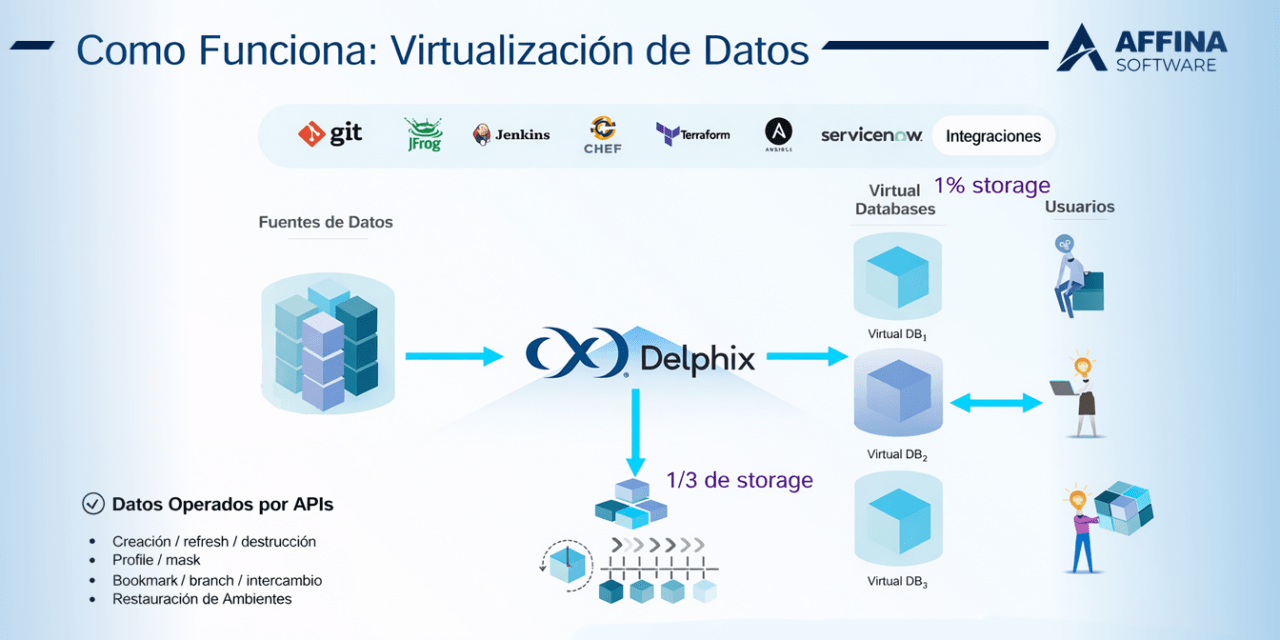

Delphix aborda este problema desde una perspectiva de DataOps, tratando los datos con la misma agilidad que el código. Su plataforma permite virtualizar bases de datos, entregando copias ligeras, actualizadas y seguras en minutos.

En lugar de crear múltiples copias físicas, Delphix genera bases de datos virtuales que comparten almacenamiento y se sincronizan continuamente con producción. Esto reduce drásticamente el tiempo de aprovisionamiento y el consumo de recursos.

Además, los datos pueden versionarse, rebobinarse y ramificarse, facilitando pruebas paralelas, experimentos y desarrollo simultáneo sin interferencias.

Integración con herramientas de automatización

Para encajar en pipelines modernos, Delphix se integra mediante APIs y conectores con herramientas de CI/CD ampliamente utilizadas, como Jenkins, Terraform, ServiceNow y GitHub.

Esto permite automatizar la creación, actualización y destrucción de ambientes de datos como parte del pipeline. Los datos dejan de ser una tarea manual y pasan a ser un componente más del flujo automatizado.

La integración también facilita la sincronización de datos entre distintas etapas del pipeline, asegurando consistencia desde desarrollo hasta staging.

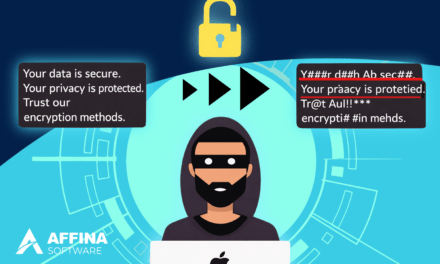

Seguridad y cumplimiento sin frenar la velocidad

Uno de los mayores retos en CI/CD es equilibrar rapidez con seguridad. Delphix incorpora descubrimiento y enmascaramiento automático de datos sensibles, preservando la integridad referencial.

Así, los equipos pueden trabajar con datos realistas sin exponer información confidencial. Esto reduce riesgos regulatorios y permite cumplir con normativas de protección de datos incluso en entornos no productivos.

Beneficios clave para ingeniería y negocio

Al eliminar los datos como cuello de botella, los beneficios se reflejan en toda la organización. Los ingenieros ganan productividad al disponer de ambientes bajo demanda y sin esperas prolongadas. Los equipos de TI reducen la carga operativa y el uso de almacenamiento.

Desde el punto de vista del negocio, los ciclos de desarrollo se aceleran, los errores se detectan antes y las aplicaciones llegan al mercado con mayor calidad. Todo esto con un menor costo de infraestructura y menor riesgo.

Conclusión: datos a la velocidad del CI/CD

La promesa de CI/CD no se cumple completamente si los datos siguen siendo lentos, pesados y riesgosos. Tratar los datos como código es el paso que falta para cerrar el círculo de la automatización.

CI/CD · Pipelines de desarrollo · Desarrollo de aplicaciones · Datos frescos · Entornos de desarrollo y pruebas · Automatización · DevOps · DataOps · Virtualización de datos · Enmascaramiento de datos · Bases de datos · Productividad de ingenieros · Optimización de almacenamiento · Delphix