Los pipelines de CI/CD han dejado de ser una ventaja competitiva para convertirse en el núcleo operativo del desarrollo moderno. Permiten integrar cambios de forma continua, automatizar pruebas y desplegar versiones con una frecuencia que hace unos años era impensable.

Pero esta velocidad tiene un costo si no se gestiona correctamente.

A medida que los pipelines se vuelven más rápidos, también se vuelven más susceptibles a introducir errores, vulnerabilidades y malas prácticas que escalan rápidamente hacia producción. En este contexto, la seguridad ya no puede ser un control posterior ni un proceso aislado.

Tiene que formar parte del flujo.

DevSecOps no propone agregar más fricción, sino rediseñar el pipeline para que la seguridad ocurra de forma natural, automática y constante. Las siguientes prácticas no son recomendaciones teóricas, sino elementos que, bien implementados, transforman la forma en que se construye software seguro.

1. Integrar la seguridad desde el diseño del pipeline

El mayor error en muchos pipelines no es la falta de herramientas, sino el momento en que se utilizan.

Cuando la seguridad se introduce al final, el pipeline ya ha procesado código potencialmente vulnerable durante varias etapas. Corregir en ese punto implica retrabajo, retrasos y pérdida de contexto técnico.

Diseñar el pipeline con seguridad desde el inicio cambia esta dinámica. Cada etapa, desde el commit hasta el despliegue, incorpora validaciones que actúan como filtros progresivos. Esto no solo mejora la calidad del código, sino que reduce la acumulación de riesgos a lo largo del proceso.

El pipeline deja de ser una línea de ensamblaje… y se convierte en un sistema de control continuo.

2. Automatizar el análisis de código como parte del flujo

La automatización no es opcional en entornos CI/CD.

Integrar análisis estático (SAST) dentro del pipeline permite detectar vulnerabilidades en el momento exacto en que se introducen. Esto elimina la dependencia de revisiones manuales y reduce significativamente el tiempo de respuesta.

Pero el valor real no está solo en detectar problemas.

Está en cómo se integran los resultados. Cuando el feedback es inmediato, claro y accionable, los desarrolladores pueden corregir sin romper su flujo de trabajo. Esto genera un ciclo de mejora continua donde la seguridad se vuelve parte del hábito, no una interrupción.

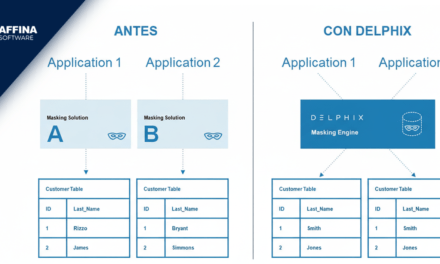

3. Incorporar análisis de dependencias con visión de riesgo

En aplicaciones modernas, gran parte del código no se escribe desde cero.

Se construye sobre librerías, frameworks y componentes de terceros. Esto acelera el desarrollo, pero también introduce vulnerabilidades externas que muchas veces pasan desapercibidas.

Integrar análisis de composición (SCA) en el pipeline permite identificar estas dependencias, evaluar su riesgo y tomar decisiones informadas. No se trata solo de detectar versiones vulnerables, sino de entender su impacto dentro del sistema.

Esto cambia la conversación.

De “tenemos una vulnerabilidad” a “tenemos un riesgo que debemos gestionar estratégicamente”.

4. Definir políticas de seguridad alineadas al negocio

Un pipeline sin criterios claros de seguridad genera inconsistencias.

Bloquear todo puede frenar la operación. No bloquear nada genera exposición. El equilibrio está en definir políticas que reflejen el contexto real del negocio.

Estas políticas deben establecer qué tipo de vulnerabilidades son críticas, cuáles pueden tolerarse temporalmente y bajo qué condiciones se permite avanzar en el pipeline.

El objetivo no es imponer reglas rígidas.

Es crear un marco de decisión coherente que permita mantener la velocidad sin perder control.

5. Priorizar vulnerabilidades en función de impacto real

No todas las vulnerabilidades tienen el mismo peso.

En pipelines activos, donde se generan múltiples hallazgos por ejecución, intentar resolver todo de inmediato es inviable. Esto genera saturación y reduce la efectividad del proceso.

La priorización basada en riesgo permite enfocar esfuerzos en lo que realmente importa. Considera factores como la exposición del sistema, la criticidad del componente y la probabilidad de explotación.

Este enfoque no elimina trabajo.

Lo hace más inteligente.

6. Integrar pruebas dinámicas sin afectar la velocidad

El análisis dinámico (DAST) permite identificar vulnerabilidades que no son visibles en el código, pero su implementación dentro del pipeline requiere estrategia.

Ejecutarlo en cada commit puede ser costoso en tiempo. Por eso, se suele integrar en etapas específicas, como entornos de staging o pruebas pre-producción.

Esto permite mantener un balance entre profundidad de análisis y eficiencia operativa.

El pipeline no se ralentiza innecesariamente, pero tampoco pierde visibilidad sobre el comportamiento real de la aplicación.

7. Reducir la fricción entre equipos mediante integración real

DevSecOps no es solo una cuestión técnica.

Es una transformación en la forma en que colaboran los equipos.

Cuando las herramientas de seguridad están desconectadas del flujo de desarrollo, generan resistencia. En cambio, cuando están integradas en los mismos entornos y procesos, se vuelven parte natural del trabajo diario.

Esto implica entregar resultados claros, integrarlos en herramientas que los desarrolladores ya usan y evitar procesos paralelos que fragmenten la operación.

La seguridad deja de ser externa.

Se vuelve parte del mismo lenguaje del desarrollo.

8. Extender el monitoreo más allá del despliegue

Un pipeline no termina en producción.

El monitoreo continuo permite detectar comportamientos anómalos, identificar nuevas vulnerabilidades y cerrar el ciclo entre desarrollo y operación.

Esto es especialmente importante en entornos donde las aplicaciones evolucionan constantemente. Lo que hoy es seguro, mañana puede no serlo.

Integrar monitoreo dentro del ciclo DevSecOps permite mantener una visión completa del sistema, más allá del código.

9. Capacitar para prevenir, no solo corregir

La mayoría de las vulnerabilidades no se originan por falta de herramientas, sino por falta de conocimiento.

Capacitar a los equipos en prácticas seguras permite reducir errores desde el origen. Esto no solo mejora la seguridad, también reduce la carga en el pipeline y en los procesos de revisión.

El objetivo no es convertir a todos en expertos en seguridad.

Es lograr que entiendan cómo sus decisiones impactan el sistema.

10. Medir el pipeline como sistema de seguridad

Lo que no se mide, no se mejora.

Un pipeline DevSecOps debe tratarse como un sistema que genera datos: tiempos de corrección, tipos de vulnerabilidades, frecuencia de fallos, eficiencia de las validaciones.

Analizar estas métricas permite identificar cuellos de botella, ajustar políticas y optimizar el proceso.

No se trata solo de medir desempeño técnico.

Se trata de entender cómo evoluciona la seguridad dentro del flujo.

Conclusión

Fortalecer pipelines con DevSecOps no implica hacerlos más pesados, sino más inteligentes. La clave está en integrar la seguridad de forma que acompañe el flujo de desarrollo, en lugar de interrumpirlo.

Cuando esto se logra, el pipeline deja de ser solo un mecanismo de entrega continua y se convierte en un sistema de validación constante, donde cada cambio es evaluado en tiempo real.